Συνέντευξη Αγιλάρ: Η χρήση του AI στα προσφυγικά camps θα απαγορευτεί

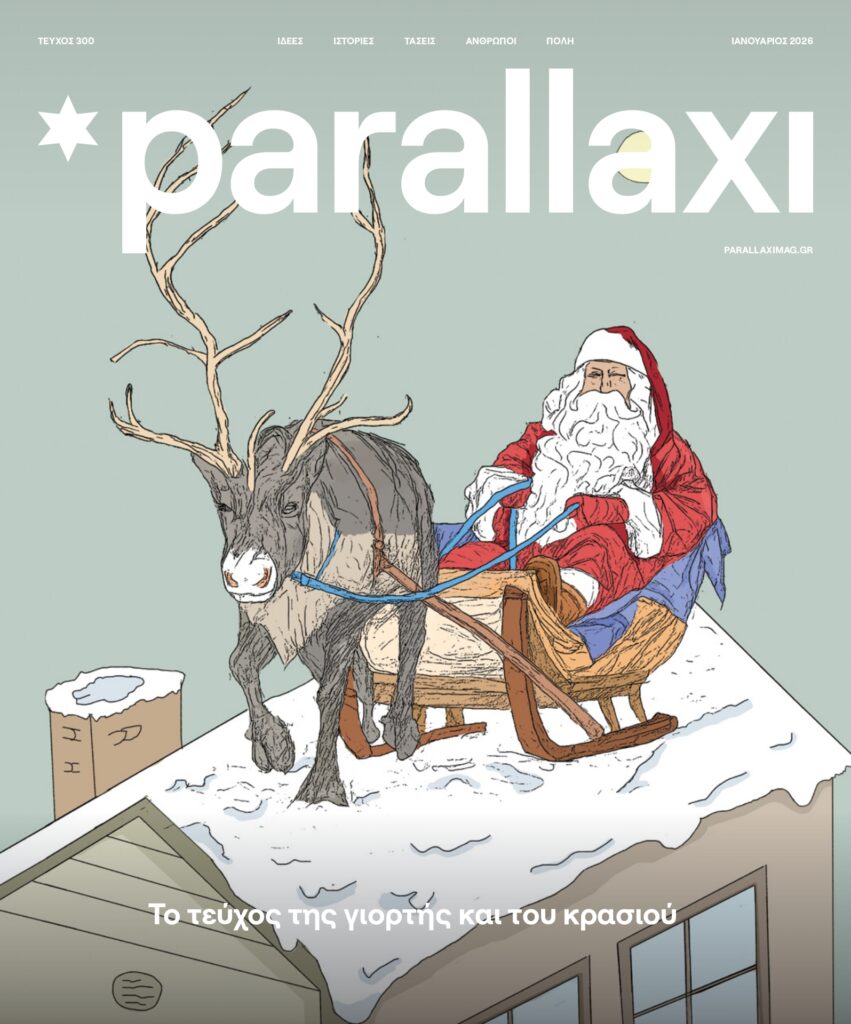

O Χουάν Φερνάντο Λόπεζ Αγκιλάρ, Ισπανός ευρωβουλευτής και πρόεδρος της Επιτροπής LIBE και μέλος της επιτροπής PEGA του Ευρωπαϊκού Κοινοβουλίου μίλησε αποκλειστικά στην Parallaxi

O Χουάν Φερνάντο Λόπεζ Αγκιλάρ, Ισπανός ευρωβουλευτής και πρόεδρος της Επιτροπής LIBE και μέλος της επιτροπής PEGA του Ευρωπαϊκού Κοινοβουλίου μίλησε αποκλειστικά στην Parallaxi μετά την πρόταση νομοθεσίας που ψήφισε το Ευρωπαϊκό Κοινοβούλιο την περασμένη Τετάρτη για την ρύθμιση της χρήσης Τεχνητής Νοημοσύνης στην Ευρωπαϊκή Ένωση.

Βρεθήκαμε στο γραφείο του στο Στρασβούργο την Πέμπτη, μια ημέρα μετά την ψήφιση του πλαισίου, και συζητήσαμε σχετικά με το χώρο που μπορεί να έχει η τεχνητή νοημοσύνη στις αποφάσεις των δικαστηρίων, τα deep fakes και τα voice clonings, καθώς και τη χρήση του AI από την ελληνική κυβέρνηση στα σύνορα του Έβρου και στα κέντρα κράτησης προσφύγων και μεταναστών. Ως πρόεδρος της μιας από τις δυο επιτροπές που διηύθυνε τις διαδικασίες για τη νομοθεσία που ψηφίστηκε, μας απαντά ότι εάν υιοθετηθεί η πρόταση αυτή, τα πειράματα της ελληνικής κυβέρνησης με την τεχνητή νοημοσύνη θα καταστούν παράνομα.

Στο παρελθόν υπηρετούσατε ως υπουργός Δικαιοσύνης στην Ισπανία και έχετε μια καλή αντίληψη για το πως λειτουργεί το σύστημα απονομής δικαιοσύνης. Υπάρχει μια συζήτηση σχετικά με τη χρήση της τεχνητής νοημοσύνης από τις αρχές για τη λήψη αποφάσεων σχετικά με ποινικές υποθέσεις. Πώς αντιδράτε σε αυτό;

Το θέμα είναι ότι καλύπτουμε μια αχαρτογράφητη περιοχή όπου η τεχνητή νοημοσύνη είναι σε μια φάση τεράστιας τεχνολογικής ανάπτυξης. Ωστόσο, η Ευρωπαϊκή Ένωση έχει επιλέξει να βρίσκεται στην πρωτοπορία της ρύθμισης του πρωτόγνωρου αυτού φαινομένου. Πρέπει να το κάνει σύμφωνα με τις αξίες και τις αρχές που την διέπουν και αυτό περιλαμβάνει μια νομική πρόβλεψη ενάντια στις διακρίσεις. Αυτό σημαίνει στην πράξη ότι ο νόμος της ΕΕ για την ΤΝ πρέπει να αναφέρει πρώτα απ’ όλα ποιες είναι οι απαγορευμένες χρήσεις της ΤΝ. Δηλαδή, η χρήση της ΤΝ για την πρόγνωση της εγκληματικής συμπεριφοράς, την αναγνώριση προσώπου, τη συναισθηματική κατάσταση του ατόμου και τη σκιαγράφηση του προφίλ των πολιτών. Αυτές οι χρήσεις που είναι ασύμβατες με τα δικαιώματα πρέπει να απαγορεύονται εντελώς. Στη συνέχεια, υπάρχουν επίσης χρήσεις υψηλού κινδύνου που πρέπει να ρυθμιστούν πολύ προσεκτικά. Αυτές αφορούν τη χρήση τεχνητής νοημοσύνης κατά την πρόσληψη ή απόλυση εργαζομένων, ή στο εκπαιδευτικό σύστημα, στη δημόσια διοίκηση. Στη συνέχεια πρέπει να υπάρξει μια ευρωπαϊκή υπηρεσία πληροφοριών ή υπηρεσία για να διασφαλιστεί ότι θα υπάρξει μια σωστή εφαρμογή στα κράτη μέλη. Συνήθως, αυτό είναι το μονοπάτι που ακολουθούμε όταν ένας νόμος επηρεάζει τα δικαιώματα των πολιτών. Για παράδειγμα, όταν θέσαμε σε εφαρμογή το GDPR ως το πιο προηγμένο πρόγραμμα προστασίας δεδομένων στον κόσμο, τοποθετήσαμε έναν ευρωπαϊκό επόπτη δεδομένων συνδεδεμένο με όλες τις αρχές που επέβλεπε την εφαρμογή του νόμου για τα προσωπικά δεδομένα. Αυτό πρέπει να συμβεί αν λάβουμε υπόψη ότι οι τεχνολογικές εξελίξεις της τεχνητής νοημοσύνης θα καταστήσουν σύντομα κάποια από αυτά που νομοθετούμε σήμερα, παρωχημένα.

Στις ΗΠΑ υπάρχει ένα πρόγραμμα που εξυπηρετεί ηλεκτρονικές απάτες με κλωνοποίηση της φωνής (voice cloning) και η χρήση του κοστίζει μόλις 1 δολάριο [2]. Υπάρχει κάποιος τρόπος να αντιμετωπίσουμε τα deep fakes και το voice cloning;

Αυτή είναι μια από τις πιο ξεκάθαρες προτάσεις που θέτουμε σε εφαρμογή με τον νόμο για την τεχνητή νοημοσύνη. Προήδρευσα του πρώτου τριμερούς διαλόγου, εγκρίναμε την πρώτη ανάγνωση, τώρα ξεκινάμε διαπραγματεύσεις με το Συμβούλιο με την προσδοκία ότι θα εγκριθεί ένα τελικό κείμενο σε αυτήν την εντολή από το Ευρωπαϊκό Κοινοβούλιο. Μπορούμε να το κάνουμε, μπορούμε να το πετύχουμε, και σίγουρα μία από τις προτάσεις είναι αυτή. Πρέπει να προσδιοριστούν όλες οι συσκευές τεχνητής νοημοσύνης, και πρέπει να δηλωθεί από εκείνους που παράγουν αυτά τα προγράμματα, συμπεριλαμβανομένων των ήχων και των εικόνων. Αυτό σημαίνει ότι δεν μπορούμε να αφήσουμε τους ανθρώπους να συγχέουν ή να σφάλλουν ως προς τα γεγονότα και ως προς την αλήθεια, με βάση συσκευές τεχνητής νοημοσύνης.

Η Ελλάδα συλλέγει βιομετρικά στοιχεία σε στρατόπεδα κράτησης προσφύγων στα νησιά και στην ενδοχώρα. Το σύστημα παρακολούθησης [1] χρησιμοποιεί και αυτό την τεχνητή νοημοσύνη για να αναλύσει την κίνηση και τη συναισθηματική κατάσταση των ατόμων. Τώρα το Υπουργείο Μετανάστευσης σκοπεύει να χρησιμοποιήσει drones στα σύνορα του Έβρου με την ίδια τεχνολογία τεχνητής νοημοσύνης. Πώς αντιδράτε εσείς και η LIBE, και πως θα αντιδράσετε στο μέλλον στην παρακολούθηση των προσφύγων με τη χρήση AI;

Θα απαγορευτεί. Το να αναγνωρίζουμε μεμονωμένα άτομα, να κάνουμε αδιάκριτη χρήση βιομετρικών στοιχείων στους δημόσιους χώρους, να χρησιμοποιούμε την αναγνώριση προσώπου ή να «σαρώνουμε» τη συναισθηματική κατάσταση για προληπτικούς σκοπούς σε δημόσιους χώρους, αυτό απαγορεύεται να χρησιμοποιείται σύμφωνα με τη νομοθεσία που πρόκειται να εφαρμόσουμε.

Πιστεύετε ότι η νομοθεσία θα έχει αντίκτυπο στην πολιτική αυτή;

Ναι, επειδή η αδιάκριτη βιομετρική ταυτοποίηση σε δημόσιους χώρους θα απαγορεύεται σύμφωνα με το νόμο της ΕΕ. Είναι ένα εντελώς διαφορετικό πράγμα η βιομετρική αναγνώριση των μεταναστών ή των αιτούντων άσυλο όταν εισέρχονται στο έδαφος της Ευρωπαϊκής Ένωσης. Εκεί, τα κράτη μέλη έχουν το δικαίωμα και στην πραγματικότητα έχουν το καθήκον, σύμφωνα με το νόμο της ΕΕ, να εξασφαλίσουν ότι καμία είσοδος δεν ενδέχεται να αποτελέσει απειλή για την ΕΕ. Όταν μπαίνω στην ΕΕ παίρνω διαβατήριο, είναι και αυτό νόμος της ΕΕ. Αλλά η αδιάκριτη και προληπτική χρήση βιομετρικών στοιχεία θα είναι μια από της χρήσης της Τεχνητής Νοημοσύνης που θα απαγορευτεί.

[1] https://algorithmwatch.org/en/greek-camps-surveillance/ [2] https://www.theatlantic.com/technology/archive/2023/04/ai-voice-cloning-imposter-scams/673879/