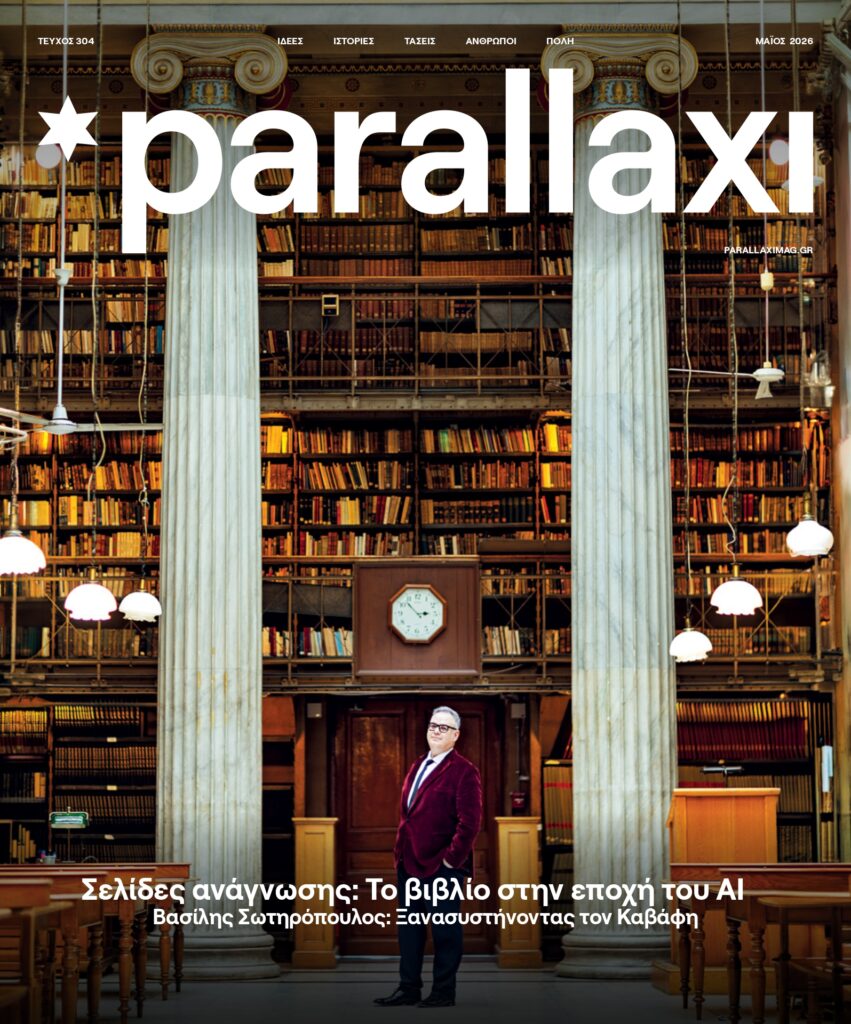

Όταν τα chatbots γίνονται καλοί εγκληματίες

Η τεχνητή νοημοσύνη είναι στην ουσία... κάπως ανόητη ή όχι;

Μια ομάδα εμπειρογνωμόνων ασφάλειας της εταιρείας τεχνητής νοημοσύνης Anthropic αποκάλυψε ένα περίπλοκο σχέδιο κυβερνοκατασκοπείας. Οι χάκερς, οι οποίοι σύμφωνα με τις υποψίες της Anthropic εργάζονταν για λογαριασμό της κινεζικής κυβέρνησης, είχαν ως στόχο κυβερνητικές υπηρεσίες και μεγάλες εταιρείες σε όλο τον κόσμο. Φαίνεται ότι χρησιμοποίησαν το ίδιο το προϊόν τεχνητής νοημοσύνης της Anthropic, το Claude Code, για να κάνουν το μεγαλύτερο μέρος της δουλειάς.

Πως έγινε η υποκλοπή δεδομένων:

Ο Jacob Klein, επικεφαλής της Anthropic για θέματα πληροφοριών σχετικά με απειλές, εξήγησε ότι οι χάκερς εκμεταλλεύτηκαν τις «ατζεντικές» ικανότητες του Claude, οι οποίες επιτρέπουν στο πρόγραμμα να εκτελεί μια εκτεταμένη σειρά ενεργειών αντί να επικεντρώνεται σε μία βασική εργασία.

Κατάφεραν να εξοπλίσουν το bot με μια σειρά εξωτερικών εργαλείων, όπως προγράμματα παραβίασης κωδικών πρόσβασης, επιτρέποντας στον Claude να αναλύει πιθανές ευπάθειες ασφαλείας, να γράφει κακόβουλο κώδικα, να συλλέγει κωδικούς πρόσβασης και να υποκλέπτει δεδομένα.

Μόλις ο Claude έλαβε τις οδηγίες του, αφέθηκε να εργαστεί μόνος του για ώρες. Όταν ολοκλήρωσε τις εργασίες του, οι χάκερς αφιέρωσαν μόλις λίγα λεπτά για να ελέγξουν το έργο του και να ενεργοποιήσουν τα επόμενα βήματα. Η επιχείρηση φαινόταν επαγγελματική και τυποποιημένη. Η ομάδα ήταν ενεργή μόνο κατά τη διάρκεια της κινεζικής εργάσιμης ημέρας, είπε ο Klein, έκανε διάλειμμα για μεσημεριανό γεύμα «με ακρίβεια ρολογιού» και φαινόταν να πηγαίνει διακοπές κατά τη διάρκεια μιας σημαντικής κινεζικής αργίας.

Τι δήλωσε η εταιρεία:

Η Anthropic δήλωσε ότι, αν και η εταιρεία τελικά διέκοψε τη λειτουργία, μερικές από τις επιθέσεις κατάφεραν να κλέψουν ευαίσθητες πληροφορίες. Υπάλληλος της εταιρίας δήλωσε πως δεν μπορούσε να δώσει περισσότερες λεπτομέρειες, αλλά ότι οι στόχοι ήταν σύμφωνοι με τους «στρατηγικούς στόχους της κινεζικής κυβέρνησης». (Ένας εκπρόσωπος της κινεζικής πρεσβείας στην Ουάσινγκτον δήλωσε στο The Wall Street Journal ότι η κυβέρνησή του «αντιτίθεται σθεναρά και καταπολεμά κάθε μορφή κυβερνοεπιθέσεων» και χαρακτήρισε τις κατηγορίες των Ηνωμένων Πολιτειών «συκοφαντία και δυσφήμιση»).

Ίσως βρισκόμαστε τώρα στην «χρυσή εποχή για τους εγκληματίες με τεχνητή νοημοσύνη», όπως ανέφερε ο διευθύνων σύμβουλος της εταιρείας κυβερνοασφάλειας Resecurity.

Η πρόσφατη επιχείρηση hacking με τη χρήση του Claude είναι μόνο ένα από τα πολλά παραδείγματα. Ομάδες hacking που χρηματοδοτούνται από κράτη και εγκληματικές οργανώσεις χρησιμοποιούν μοντέλα τεχνητής νοημοσύνης για κάθε είδους κυβερνοεπιθέσεις. Οι εταιρείες Anthropic, OpenAI και άλλες εταιρείες τεχνητής νοημοσύνης διαφημίζουν με υπερηφάνεια την ικανότητα της τεχνητής νοημοσύνης να γράφει κώδικα. Ωστόσο, αυτό που αποτελεί ευλογία για τις αξιόπιστες επιχειρήσεις και τους μηχανικούς λογισμικού, αποτελεί ευλογία και για τους εγκληματίες του κυβερνοχώρου.

«Οι προγραμματιστές κακόβουλου λογισμικού είναι προγραμματιστές»

Ο διευθυντής του NSF AI Institute for Agent-Based Cyber Threat Intelligence and Operation ανέφερε ότι φυσικά και θα εκμεταλλευτούν την τεχνητή νοημοσύνη «ένας μαθητής μπορεί να χρησιμοποιήσει ένα chatbot για να τελειώσει γρήγορα τα μαθήματά του στην ιστορία, ενώ ένας χάκερ μπορεί να το χρησιμοποιήσει για να επιταχύνει εργασίες που διαφορετικά θα του έπαιρναν ώρες ή μέρες».

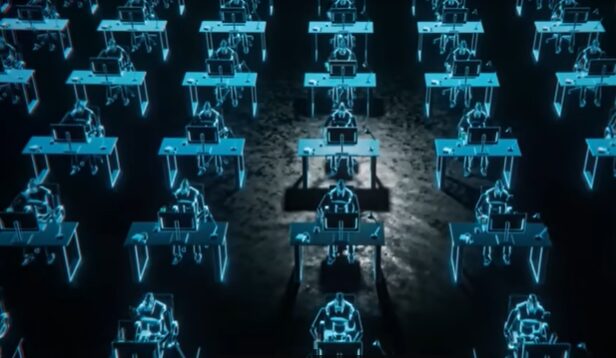

Αξιόπιστες εταιρείες τεχνολογίας προσπαθούν να θέσουν σε εφαρμογή μέτρα ασφαλείας για να αποτρέψουν τη χρήση των bot τους για τη δημιουργία κακόβουλου κώδικα και αυτά όμως μπορούν να παρακαμφθούν. Οι OpenAI, Google και Anthropic έχουν αποκαλύψει ομάδες χάκερ από τη Ρωσία, το Ιράν και την Κίνα, μεταξύ άλλων, που χρησιμοποιούν τα μοντέλα τεχνητής νοημοσύνης τους για να επιταχύνουν και να επεκτείνουν τις δραστηριότητές τους. Μια εγκληματική οργάνωση ή μια υπηρεσία πληροφοριών μπορεί να έχει συνήθως δεκάδες ή εκατοντάδες εξειδικευμένους χάκερ στο δυναμικό της, ας υποθέσουμε ότι με το πάτημα ενός κουμπιού μπορείτε να έχετε ένα εκατομμύριο από αυτούς, αυτή είναι η δύναμη της τεχνητής νοημοσύνης.

Τα μοντέλα τεχνητής νοημοσύνης μπορεί να μην λειτουργούν στο επίπεδο ενός ανθρώπινου προγραμματιστή, αλλά η απειλή τους είναι ήδη εμφανής. Σε ένα πρόσφατο πείραμα που πραγματοποίησε μια ομάδα στο Πανεπιστήμιο της Καλιφόρνια στο Μπέρκλεϊ, χρησιμοποιήθηκαν πράκτορες τεχνητής νοημοσύνης για τον εντοπισμό 35 νέων κενών ασφαλείας σε μια ομάδα δημόσιων βάσεων κώδικα.

Τα bots είναι σε θέση να εντοπίζουν ευπάθειες που οι άνθρωποι δεν μπορούν να δουν

Η γενετική τεχνητή νοημοσύνη μπορεί να μας ωθεί προς κάτι σαν το χειρότερο σενάριο για τη βασική ασφάλεια στον κυβερνοχώρο. Οι άνθρωποι αρχίζουν να αναπτύσσουν κακόβουλο λογισμικό που μπορεί να χρησιμοποιεί μεγάλα γλωσσικά μοντέλα για να γράφει προσαρμοσμένο κώδικα για κάθε απόπειρα hacking, αντί να χρησιμοποιεί το ίδιο πρόγραμμα για κάθε μηχανή ή βάση δεδομένων που στοχεύει, μια διαδικασία που καθιστά τις επιθέσεις πολύ πιο δύσκολες να ανιχνευθούν και για την οποία οι ειδικοί σε θέματα ασφάλειας ανησυχούν. Mια ψηφιακή μαύρη αγορά για εργαλεία hacking AI καθιστά ακόμη και τις πιο προηγμένες τεχνικές όλο και πιο προσιτές. Οι λιγότερο εξειδικευμένοι hackers είναι πλέον σε θέση να εξαπολύουν πολύ πιο αποτελεσματικές επιθέσεις από ό,τι θα μπορούσαν πριν από λίγα χρόνια. Τα bots κάνουν τις εισβολές πιο γρήγορες, ίσως σε τέτοιο βαθμό που, μέχρι να ενεργοποιηθούν οι αμυντικοί μηχανισμοί, ο εισβολέας μπορεί να έχει εισχωρήσει βαθιά στο δίκτυό σας.

Δεν είναι μόνο ότι τα εργαλεία τεχνητής νοημοσύνης είναι ισχυρά.

Στην πραγματικότητα, ένα άλλο πρόβλημα είναι ότι η τεχνητή νοημοσύνη είναι στην ουσία… κάπως ανόητη. Οι επιχειρήσεις έσπευσαν να εγκαταστήσουν δημοφιλή chatbots και πράκτορες τεχνητής νοημοσύνης, αλλά αυτά τα προγράμματα είναι τα ίδια ευάλωτα σε κάθε είδους έξυπνες και καταστροφικές επιθέσεις. Κανείς δεν κάνει πραγματικά επαρκή μοντελοποίηση απειλών, μια εταιρεία που βιάζεται να βάλει, για παράδειγμα, bots εξυπηρέτησης πελατών μπροστά στους χρήστες μπορεί να ανοίγει έναν νέο δρόμο για τους χάκερς να προωθήσουν κακόβουλο κώδικα και να αποκτήσουν πρόσβαση στα δεδομένα ή τα διαπιστευτήρια ασφαλείας των χρηστών. Όλο και περισσότεροι μηχανικοί λογισμικού (και ερασιτέχνες) χρησιμοποιούν την τεχνητή νοημοσύνη για να δημιουργήσουν κώδικα, χωρίς να αφιερώνουν χρόνο (ή ακόμη και να γνωρίζουν πώς) να κάνουν βασικούς ελέγχους ασφαλείας, γεγονός που εισάγει πολλές νέες ευπάθειες στον τομέα της ασφάλειας.

Οι επαγγελματίες του τομέα της πληροφορικής προσπαθούν να αξιοποιήσουν την τεχνολογία για την ασφάλεια στον κυβερνοχώρο.

Μπορεί να υπάρχουν 1 εκατομμύριο εικονικοί χάκερ, έτσι και μια εταιρεία θα μπορούσε να δημιουργήσει «εκατομμύρια εικονικούς αναλυτές ασφάλειας» για να εξετάσουν τον κώδικα σας, κάτι που θα μπορούσε να έχει δυσανάλογα οφέλη για τους συνήθως υποστελεχωμένους εμπειρογνώμονες του τομέα της πληροφορικής. Αρκετοί ειδικοί στον τομέα της κυβερνοασφάλειας ανέφεραν ότι η τεχνολογία αυτή θα μπορούσε να αποδειχθεί ευεργετική για την άμυνα των δικτύων μακροπρόθεσμα. Τα εργαλεία τεχνητής νοημοσύνης μπορούν να προσφέρουν τη δυνατότητα ελέγχου μεγάλων ψηφιακών υποδομών, ανά πάσα στιγμή και με πρωτοφανείς ταχύτητες.

Ένας αμείλικτος αγώνας εξοπλισμών στον τομέα της τεχνητής νοημοσύνης βρίσκεται σε εξέλιξη και κανείς δεν μπορεί να πει με βεβαιότητα ποιος θα βγει νικητής. Βραχυπρόθεσμα, η έκρηξη της τεχνητής νοημοσύνης μπορεί να δώσει το πλεονέκτημα στους εγκληματίες του κυβερνοχώρου. Ακόμη και πριν από το ChatGPT, οι επιτιθέμενοι είχαν το πλεονέκτημα. Oι χάκερ πρέπει να ανακαλύψουν μόνο μία ευπάθεια για να πετύχουν, ενώ οι υπερασπιστές πρέπει να παραλείψουν μόνο μία για να αποτύχουν. Οι χάκερ θα δοκιμάσουν γρήγορα νέες μεθόδους, ενώ οι επιχειρήσεις πρέπει να είναι αργές και προσεκτικές.

Κανείς δεν μπορεί να προβλέψει πλήρως τις συνέπειες

Όσο καλύτεροι γίνονται οι επιτιθέμενοι στη χρήση μοντέλων τεχνητής νοημοσύνης και όσο καλύτερη γίνεται η ίδια η τεχνολογία, τόσο πιο δύσκολο θα είναι να προστατευτούμε από τις εισβολές. Από την άλλη πλευρά, τα προϊόντα τεχνητής νοημοσύνης που ανακαλύπτουν νέα κενά ασφαλείας θα μπορούσαν επίσης να βοηθήσουν στην επιδιόρθωση αυτών των σφαλμάτων. Ωστόσο, ανεξάρτητα από το πόσο γρήγορα ένα εργαλείο ασφάλειας τεχνητής νοημοσύνης μπορεί να εντοπίσει μια ευπάθεια, οι μεγάλες εταιρείες και οι κυβερνητικές υπηρεσίες είναι πολύ πιο επιφυλακτικές έναντι των κινδύνων από τους χάκερ. Tο παραμικρό λάθος μπορεί να καταστρέψει ολόκληρο το κώδικα ή την επιχείρηση. Αυτό σημαίνει ότι ακόμη και αν η τεχνητή νοημοσύνη μπορεί να εντοπίσει γρήγορα τα σφάλματα, οι υπερασπιστές μπορεί να παραμείνουν πιο αργοί στην επιδιόρθωσή τους. Τα τελευταία χρόνια, οι κυβερνοεπιθέσεις έχουν εξελιχθεί, αλλά οι τεχνικές για την πραγματοποίηση αυτών των παραβιάσεων έχουν παραμείνει σχετικά σταθερές, κανείς δεν μπορεί να προβλέψει πλήρως τις συνέπειες.

*Πηγή The Atlantic