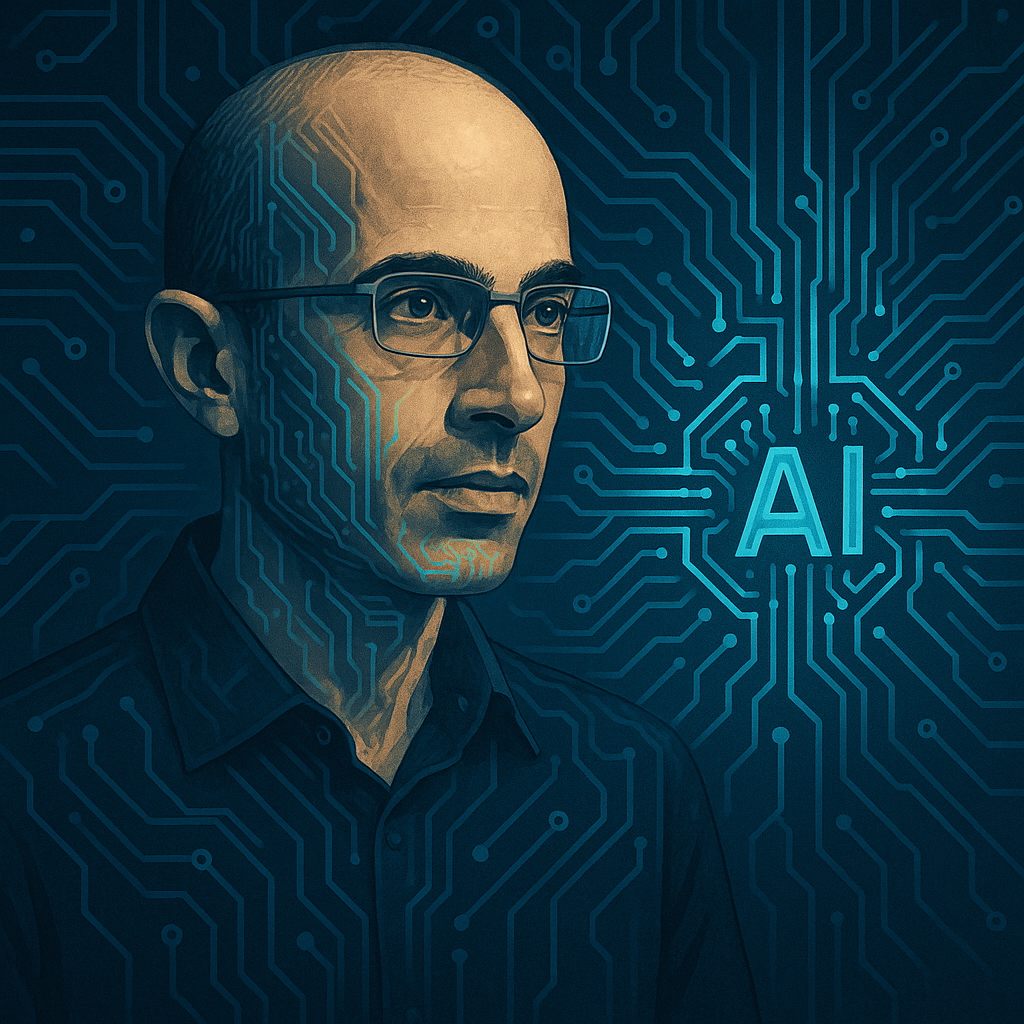

Ο Χαράρι και το AI

Ο Δημήτρης Δημητριάδης γράφει με αφορμή τη ρητορική του διάσημου ιστορικού γύρω από την Τεχνητή Νοημοσύνη

Λέξεις: Δημήτρης Δημητριάδης

Πολλοί άνθρωποι με ρωτούν τι πιστεύω για τον Yuval Noah Harari και τις “προβλέψεις” του για την Τεχνητή Νοημοσύνη. Η αλήθεια είναι πως εκτιμώ τη συμβολή του στο δημόσιο διάλογο. Τον διαβάζω, τον ακούω, τον σέβομαι ως στοχαστή. Όμως νιώθω ολοένα και πιο έντονα ότι κάτι δεν πάει καλά με τη ρητορική του γύρω από την AI.

Δεν είναι απλώς ότι διαφωνώ. Είναι ότι, όσο περισσότερο δουλεύω στην αιχμή της καινοτομίας, τόσο περισσότερο βλέπω πόσο επικίνδυνος μπορεί να γίνει ο τεχνολογικός φαταλισμός: η ιδέα πως δεν έχουμε πλέον επιλογές. Πως η τεχνητή νοημοσύνη είναι μια ανεξέλεγκτη δύναμη που απλώς «θα συμβεί» και είτε θα μας σώσει είτε θα μας εξαφανίσει.

Αυτό το αφήγημα, όσο κινηματογραφικό κι αν είναι, στερεί από τους ανθρώπους το πιο σημαντικό τους εργαλείο: την αίσθηση ότι έχουν λόγο στο μέλλον τους. Και γι’ αυτό έγραψα αυτό το κείμενο.

Όχι για να ακυρώσω τον Χαράρι. Αλλά για να δείξω ότι υπάρχει και μια άλλη προοπτική – μια πιο υπεύθυνη, πιο ελπιδοφόρα και, κυρίως, πιο ανθρώπινη. Μια προοπτική που δεν παραδίδει τα ηνία της Ιστορίας σε έναν “αλγόριθμο”.

Διαβάστε το άρθρο, αν θέλετε. Ελπίζω να σας κάνει να σκεφτείτε και να νιώσετε ξανά τη δύναμη που έχουμε όλοι μας να επηρεάζουμε το μέλλον.

Η φωνή του Yuval Noah Harari έχει γίνει σχεδόν συνώνυμη με τις μεγάλες αφηγήσεις για το παρελθόν και το μέλλον της ανθρωπότητας. Η ικανότητά του να αποστάζει περίπλοκες ιστορικές και φιλοσοφικές ιδέες σε εκλαϊκευμένα best-sellers τον έχει μετατρέψει σε παγκόσμιο φαινόμενο. Ωστόσο, όταν μιλά για την Τεχνητή Νοημοσύνη, ο λόγος του – αν και αναμφίβολα διεγερτικός – συχνά γλιστρά σε υπεραπλουστεύσεις και έναν τεχνολογικό ντετερμινισμό που τελικά αφαιρεί από εμάς τη δύναμη να σχεδιάσουμε ένα αισιόδοξο και δημοκρατικό μέλλον.

Ως άνθρωπος που ασχολείται συστηματικά με τη διασταύρωση τεχνολογίας και ανθρώπινης προόδου, θεωρώ απαραίτητο να αντικρούσουμε κάποιες από τις πιο ανησυχητικές – και λανθασμένες – παραδοχές του Χαράρι γύρω από την AI. Η Τεχνητή Νοημοσύνη έχει προκλήσεις και ηθικά διλήμματα, αλλά η παρουσίασή της ως «εξωγήινης νοημοσύνης» ή ως προάγγελος μιας «άχρηστης τάξης» παραβλέπει κρίσιμες αποχρώσεις και υποτιμά την επιμονή της ανθρώπινης βούλησης.

Ας δούμε πιο προσεκτικά μερικές από τις βασικές προβληματικές αφηγήσεις:

Ο Χαράρι διατείνεται ότι η AI δεν είναι απλώς ένα εργαλείο, αλλά ένας «πράκτορας» που μπορεί να λαμβάνει αποφάσεις, να καινοτομεί και να εξελίσσεται μόνος του. Μάλιστα, μιλά για οπλικά συστήματα που “θα επιλέγουν μόνα τους τον στόχο και θα σχεδιάζουν την επόμενη γενιά όπλων”.

Αυτός ο ισχυρισμός είναι γοητευτικός αλλά εσφαλμένος. Οι σημερινές ΑΙ, ακόμα και τα πιο προηγμένα μεγάλα γλωσσικά μοντέλα, είναι πολύπλοκοι αλγόριθμοι – όχι συνειδητά όντα. Δεν έχουν βούληση, επίγνωση ή προθέσεις. Όταν «αποφασίζουν», εκτελούν εντολές, ακολουθούν στατιστικά μοτίβα ή κανόνες που τους δόθηκαν από ανθρώπους. Δεν πρόκειται για ανεξάρτητα υποκείμενα· πρόκειται για εξελιγμένες μορφές αυτοματοποίησης.

Ο πραγματικός κίνδυνος δεν είναι ότι η AI θα στραφεί από μόνη της εναντίον μας, αλλά η ανθρώπινη κακοδιαχείριση, η συστημική αποτυχία ή η έλλειψη ηθικών ορίων κατά τον σχεδιασμό και την εφαρμογή της. Επομένως, η προσοχή μας πρέπει να είναι στραμμένη στους ανθρώπους που τη σχεδιάζουν, τη ρυθμίζουν και τη χρησιμοποιούν.

Μαθαίνοντας τις Ανθρώπινες Αδυναμίες: Η Ηθική AI Δεν Είναι Μόνο Αντανάκλαση

Ο Χαράρι ισχυρίζεται ότι η AI θα «αντιγράψει τη συμπεριφορά μας, όχι τις οδηγίες μας» – με λίγα λόγια, αν εμείς λέμε ψέματα και εξαπατούμε, το ίδιο θα κάνει και εκείνη. Και ότι η προσδοκία για ηθική AI σε έναν ανταγωνιστικό κόσμο είναι ουτοπική.

Όμως αυτό παραγνωρίζει μια τεράστια παγκόσμια κινητοποίηση στον χώρο της ευθυγράμμισης της AI με ανθρώπινες αξίες. Χιλιάδες ερευνητές εργάζονται καθημερινά σε μεθοδολογίες όπως το reinforcement learning from human feedback (RLHF), η «συνταγματική AI», και οι τεχνικές αποπλάνησης προκαταλήψεων (adversarial training), για να περιορίσουν κινδύνους και να χτίσουν αξιακά πλαίσια μέσα στα ίδια τα μοντέλα.

Δεν είναι παθητική αντιγραφή, αλλά ενεργός σχεδιασμός προς το συλλογικό όφελος. Το να υποθέτουμε πως η AI θα ενσαρκώσει μόνο τις σκοτεινές πλευρές του ανθρώπου, παραβλέπει τις ηθικές και τεχνολογικές προόδους που γίνονται κάθε μέρα.

Η «Άχρηστη Τάξη»: Μια Πολιτική Προφητεία, Όχι Τεχνολογική

Η ιδέα μιας «άχρηστης τάξης» που καθίσταται περιττή από την AI, ιδίως σε λευκά κολάρα, είναι από τις πιο τρομακτικές θεωρίες του Χαράρι. Όμως αυτό το μέλλον δεν είναι νομοτελειακό:

- Συμπληρωματικότητα Ανθρώπου-AI: Η AI δεν χρειάζεται να αντικαταστήσει τον άνθρωπο. Μπορεί να λειτουργήσει ως επιταχυντής των ικανοτήτων μας, αυτοματοποιώντας επαναλαμβανόμενα έργα και απελευθερώνοντας τον χρόνο και τη δημιουργικότητά μας.

- Νέες Θέσεις και Τομείς: Κάθε βιομηχανική επανάσταση δημιούργησε νέες δουλειές και αγορές. Το ίδιο μπορεί να συμβεί τώρα, με τις σωστές επενδύσεις σε εκπαίδευση, κατάρτιση και συστήματα κοινωνικής στήριξης.

- Η Πολιτική Είναι το Κλειδί: Δεν είναι η τεχνολογία που καθιστά τους ανθρώπους «άχρηστους», αλλά η πολιτική απόφαση να μην επενδύσουμε σε μετάβαση και αναδιανομή ευκαιριών.

Η Ανθρώπινη Βούληση Δεν Καταργείται – Ενεργοποιείται

Η μεγαλύτερη αδυναμία στο αφήγημα του Χαράρι είναι ο τεχνολογικός ντετερμινισμός: η ιδέα ότι η τεχνολογία θα καθορίσει το μέλλον μας ανεξάρτητα από τη βούλησή μας.

Η πραγματικότητα είναι το ακριβώς αντίθετο: Η ανθρώπινη βούληση είναι πιο κρίσιμη από ποτέ.

Εμείς χτίζουμε, ρυθμίζουμε και χρησιμοποιούμε την ΤΝ. Το μέλλον της δεν είναι προδιαγεγραμμένο· είναι ένα κενό καμβάς που μπορούμε ακόμα να σχεδιάσουμε. Και αυτός ο σχεδιασμός μπορεί να περιλαμβάνει:

- Υπεύθυνη Καινοτομία: Επενδύσεις στην ασφάλεια της AI, διαφάνεια, και θεσμικά πλαίσια που εξισορροπούν πρόοδο και ηθική.

- AI για το Κοινό Καλό: Χρήση της AI για την επίλυση παγκόσμιων προκλήσεων – από την υγεία και την κλιματική κρίση μέχρι τη μάθηση και την κοινωνική ένταξη.

- Πολιτικές Ανθρωποκεντρικές: Συστήματα που διασφαλίζουν δίκαιη μετάβαση, κοινωνική προστασία, και πρόσβαση σε όλους.

Ο Χαράρι προσφέρει χρήσιμα σενάρια προειδοποίησης. Όμως δεν μπορούμε να μείνουμε εγκλωβισμένοι στον φόβο. Η στρατηγική προόραση απαιτεί ενεργή συμμετοχή, πληροφορημένη στάση και συλλογική ευθύνη. Η τελική επίδραση της AI δεν θα είναι αποτέλεσμα κάποιας “εξωγενούς δύναμης”, αλλά καθρέφτης των επιλογών μας και του ποιοι επιλέγουμε να είμαστε ως ανθρωπότητα.

*Ο Δημήτρης Δημητριάδης είναι Futurist & CIO στην εταιρεία TheFutureCats Innovation Consultancy