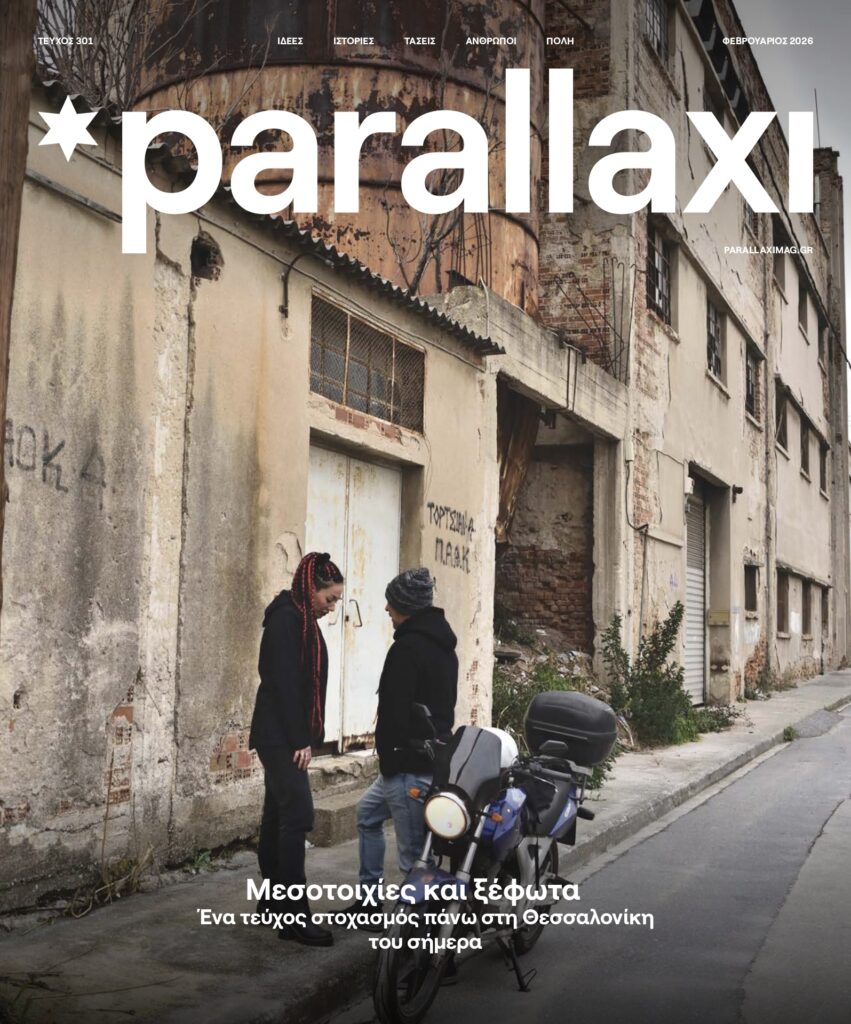

«ΑΙ slop»: Γιατί εθιζόμαστε τόσο πολύ με το περιεχόμενο Τεχνητής Νοημοσύνης στα social media;

Τα αγαπάς ή τα μισείς, σίγουρα όμως τα έχεις δει στην αρχική σου - Ποιοι είναι οι κίνδυνοι του φαινομενικά αθώου περιεχομένου με ΑΙ;

Συγκινητικές ιστορίες με οικογένειες γατιών ενώ στο background παίζει το «What Was I Made For?» της Billie Eilish με… νιαουρίσματα, νεογέννητα μωρά που λένε τη μία ατάκα μετά την άλλη, σκύλοι που κάνουν podcasts, κουνέλια σε τραμπολίνο, γιαγιάδες που δίνουν συνεντεύξεις στον δρόμο. Καλώς ήρθες στον κόσμο του «AI slop»!

Ας το παραδεχθούμε, οι περισσότεροι από εμάς έχουμε παρακολουθήσει κάποιο από τα παραπάνω βίντεο έστω και μία φορά στο Tik Tok, έχουμε γελάσει και ίσως ακόμα και για ένα δευτερόλεπτο να ξεγελαστήκαμε πριν δούμε το «AI Generated» και να πιστέψαμε ότι πρόκειται για κάτι αληθινό.

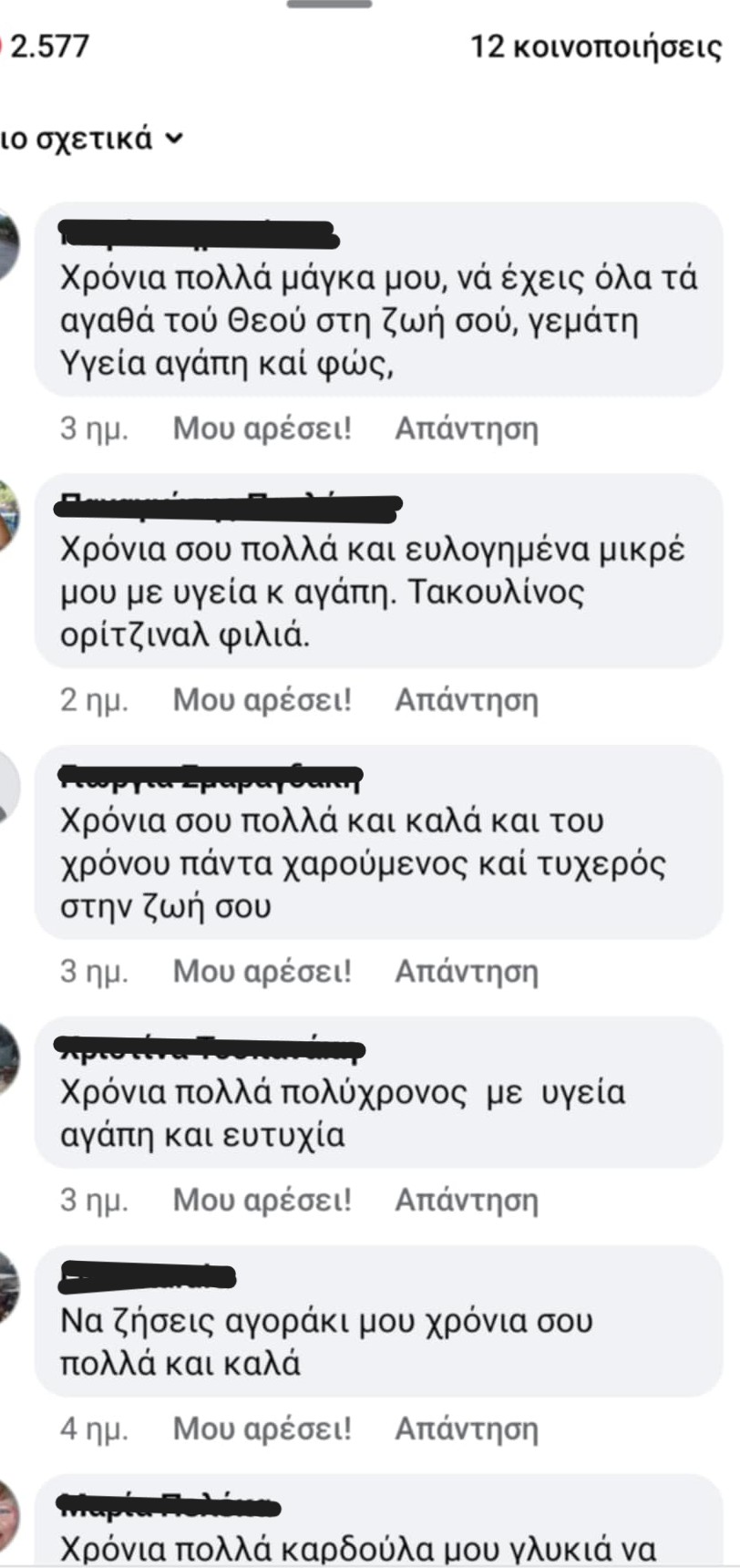

Οι boomers ή οι τεχνολογικά αμύητοι, που ίσως δεν έχουν Tik Tok και ανήκουν στη γενιά του Facebook, έχουν συναντήσει την άλλη πλευρά του ίδιου νομίσματος – φωτογραφίες τεχνητής νοημοσύνης με παππούδες/ γιαγιάδες/μικρά παιδιά και μία τούρτα στα χέρια που… «περνάνε μόνοι τους τα γενέθλιά τους» και ζητάνε ευχές.

Σε μία άλλη πλευρά του διαδικτύου, το Reddit, αναρτήσεις υψηλής αλληλεπίδρασης με μη ρεαλιστικά σενάρια (π.χ. «Είμαι εγώ ο μ@λ@κ@ς που είπα στον αρραβωνιαστικό της ερωμένης του άντρα μου για τη σχέση τους;») δημιουργούνται από AI και μαζεύουν χιλιάδες ψήφους και σχόλια στην εφαρμογή, ενώ οι χρήστες έχουν εκφράσει επανειλημμένα την απογοήτευσή τους για την εξάπλωση αυτού του είδους περιεχομένου.

Το μόνο σίγουρο είναι, ότι σε όποια γενιά και να ανήκεις, πλέον δεν μπορείς να ξεφύγεις εύκολα από το περιεχόμενο που δημιουργείται με Τεχνητή Νοημοσύνη στα social media.

Πλέον, το εύπεπτο αυτό περιεχόμενο έχει όνομα και λέγεται «AI slop» – δηλαδή φθηνό, χαμηλής ποιότητας περιεχόμενο από AI, το οποίο δημιουργείται και μοιράζεται από οποιονδήποτε, από μικρούς και μεγαλύτερους influencers έως συντονισμένες πολιτικές επιχειρήσεις επιρροής.

@the_meow_minute The Evil Stepmother. #aicat #sadcat #catshorts #cat #cattales #meow #fyp #catfunny #kitten ♬ Originalton – Cat_adventures

@nueflow_Πλένοντας πιάτα και μιλώντας στον τζέρτζελο του TikTok♬ original sound – Nue Flow

@petloversgreece Ποιος είναι ο περίεργος τώρα; 😂 #petloversgreece #κατοικιδια #σκυλος ♬ original sound – Pet Lovers Greece

@babyme8651 Send me back 😅 #baby #cutebaby #fyp #ai #apt ♬ original sound – babyme

@stupidais I just checked the home security cam and caught these guys on the trampoline… glad they’re enjoying! LOL @Ring #bunny #ringdoorbell #ring #bunnies #trampoline ♬ original sound – stupidai

@flyeinterviews Do you agree or nah? @Baddie Betty 💖 #streetinterview #veo3 #ai ♬ Dramamine – Flawed Mangoes

Οι δημοσιεύσεις που έχουν δημιουργηθεί με ΑΙ αυτή τη στιγμή δέχονται εκατομμύρια likes, δεκάδες χιλιάδες σχόλια, αποθηκεύσεις και κοινοποιήσεις, σε όλες τις εφαρμογές των μέσων κοινωνικής δικτύωσης.

Η ανάλυση των δεδομένων της εταιρείας ανάλυσης Playboard από την Guardian δείχνει ότι από τα 100 κανάλια στο Youtube με την ταχύτερη ανάπτυξη τον Ιούλιο του τρέχοντος έτους, τα εννέα παρουσίαζαν αποκλειστικά περιεχόμενο που είχε δημιουργηθεί με τεχνητή νοημοσύνη.

Από τις αναρτήσεις στο Reddit που εξοργίζουν τους αναγνώστες έως τα συγκινητικά βίντεο με γάτες, το «AI slop» τραβάει την προσοχή των χρηστών πολύ ευκολότερα και είναι επομένως επικερδές, τόσο για τους δημιουργούς όσο και για τις πλατφόρμες.

To ψεύτικο αλλιώς περιεχόμενο είναι πολλές φορές γνωστό και ως «clickbait» – μια τακτική για να κάνει τους ανθρώπους να κάνουν «like», να σχολιάζουν και να μοιράζονται, ανεξάρτητα από την ποιότητα της ανάρτησης. Και δεν χρειάζεται να αναζητήσετε το περιεχόμενο για να εκτεθείτε σε αυτό!

Άλλοι αναγνωρίζουν κατευθείαν το ΑΙ περιεχόμενο και το καταναλώνουν ως ένα ακόμα προϊόν για τη διασκέδασή τους. Την ίδια στιγμή, οι μεγαλύτεροι σε ηλικία συνήθως πέφτουν στην «παγίδα» του, πιστεύοντας ότι πρόκειται για κάτι αληθινό.

Και για να είμαστε ειλικρινείς, δεν είναι πάντα φανερό ότι πρόκειται για Τεχνητή Νοημοσύνη.

To επίπεδο του ρεαλισμού στα βίντεο είναι τουλάχιστον τρομακτικό, με τις φωνές και τις κινήσεις των ανθρώπων, ακόμα και των ζώων να συγχρονίζονται απόλυτα, ενώ το περιεχόμενο που παρουσιάζουν είναι κατά κάποιον τρόπο… εθιστικό.

Οι ερευνητές των deepfakes — εικόνες και βίντεο που δημιουργούνται με τεχνητή νοημοσύνη και είναι τόσο πειστικά που μπορούν να ξεγελάσουν τους ανθρώπους και να τους κάνουν να πιστέψουν ότι είναι αληθινά — λένε ότι αυτή η αντιγραφή φαίνεται να αντιπροσωπεύει έναν νέο τρόπο με τον οποίο η τεχνητή νοημοσύνη χρησιμοποιείται για να εξαπατήσει: η τεχνητή νοημοσύνη επαναλαμβάνει τα πραγματικά λόγια ενός αληθινού ατόμου, μέχρι και τα παραπατήματα, τα «εμ» και τα «ε».

Ωστόσο, όταν έχει περάσει αρκετή ώρα από την κατανάλωση αυτού του περιεχομένου, όταν έχεις δει τα γατάκια να κλαίνε ξανά και ξανά και τα μωρά να λένε ατάκες που δεν μπορούσες να φανταστείς και σε πονάνε τα μάγουλά σου από τα γέλια, έρχεται η στιγμή που αναρωτιέσαι: «Τι κάθομαι και βλέπω;».

Νιώθουμε ότι «σαπίζουμε» λίγο περισσότερο τον εγκέφαλό μας από όσο θα έπρεπε κι όμως συνεχίζουμε και είμαστε κολλημένοι στις οθόνες μας, θέλουμε και άλλο και ακόμα και αν δεν το αναζητάμε, αυτό εμφανίζεται με τον έναν ή τον άλλο τρόπο μπροστά μας.

Οι κίνδυνοι

«Η τεχνητή νοημοσύνη πλημμυρίζει το διαδίκτυο με περιεχόμενο που είναι ουσιαστικά σκουπίδια», δήλωσε ο Δρ Akhil Bhardwaj, αναπληρωτής καθηγητής στη Σχολή Διοίκησης του Πανεπιστημίου του Bath.

«Αυτή η υποβάθμιση καταστρέφει τις διαδικτυακές κοινότητες στο Pinterest, ανταγωνίζεται τους καλλιτέχνες στο Spotify για έσοδα και πλημμυρίζει το YouTube με περιεχόμενο κακής ποιότητας. Ένας τρόπος για τα social media να ρυθμίσουν την κακή ποιότητα της τεχνητής νοημοσύνης είναι να διασφαλίσουν ότι δεν μπορεί να αποφέρει κέρδη, αφαιρώντας έτσι το κίνητρο για τη δημιουργία της», τονίζει ο ίδιος.

Το Instagram και το TikTok απαιτούν όλο το ρεαλιστικό περιεχόμενο που έχει δημιουργηθεί με τεχνητή νοημοσύνη να φέρει σχετική επισήμανση.

Και το YouTube πρόσφατα τροποποίησε μία από τις πολιτικές του: ήδη απαγόρευε στους χρήστες να κερδίζουν χρήματα από «επαναλαμβανόμενο» περιεχόμενο και επέκτεινε την απαγόρευση αυτή στον ευρύτερο όρο «μη αυθεντικό» περιεχόμενο.

«Δεν νομίζω ότι αυτό το βίντεο υπάρχει για οποιονδήποτε δημιουργικό, εκφραστικό, ενημερωτικό ή εκπαιδευτικό λόγο. Είναι καθαρά για να προσελκύει την προσοχή», δήλωσε ο Adam Bumas, από το ενημερωτικό δελτίο Garbage Day που επικεντρώνεται στην τεχνολογία.

«Η τεχνητή νοημοσύνη ενισχύει πραγματικά το spam», δήλωσε ο Jason Koebler, συνιδρυτής του ιστότοπου τεχνολογικών ειδήσεων 404Media, ο οποίος παρακολουθεί την άνοδο της τεχνητής νοημοσύνης. «Ο στόχος είναι να επηρεαστεί με κάποιο τρόπο ο αλγόριθμος — βασικά να κερδίσει κανείς την αλγοριθμική λοταρία, να κάνει τους ανθρώπους να αρέσουν, να σχολιάσουν, να μοιραστούν και να γίνει πολύ viral».

Ο Koebler δήλωσε ότι ο μεγάλος όγκος μαζικά παραγόμενου «AI slop» καταστρέφει άλλους δημιουργούς περιεχομένου στα social media — όπως καλλιτέχνες ή φωτογράφους που εργάζονται χωρίς AI.

Σε ορισμένες περιπτώσεις, τα AI slop μπορεί να είναι κάτι περισσότερο από μια ενόχληση. Μερικά από αυτά είναι καθαρά παραπληροφόρηση, όπως τα ψεύτικα βίντεο με διασημότητες που σώζουν ανθρώπους από τις πλημμύρες του Ιουλίου στο Τέξας.

Όμως, το κομμάτι της παραπληροφόρησης ξεφεύγει από το διασκεδαστικό AI slop και μπορεί να έχει σοβαρές και κρίσιμες συνέπειες στο μέλλον.

Η τεχνητή νοημοσύνη μπορεί να δημιουργήσει με φθηνό και αποτελεσματικό τρόπο παραπληροφόρηση σχετικά σημαντικά ζητήματα της κοινωνίας, όπως είναι οι εκλογές.

Πολιτικοί παράγοντες, μεταξύ των οποίων και από αυταρχικές χώρες όπως η Ρωσία, η Κίνα και το Ιράν, επενδύουν σημαντικά ποσά σε επιχειρήσεις που βασίζονται στην τεχνητή νοημοσύνη, με σκοπό να επηρεάσουν τις εκλογές σε δημοκρατικές χώρες.

Ακόμη και το φαινομενικά απολιτικό περιεχόμενο που παράγεται από τεχνητή νοημοσύνη μπορεί να έχει συνέπειες.

Ο τεράστιος όγκος του καθιστά δύσκολη την πρόσβαση σε πραγματικές ειδήσεις και περιεχόμενο που παράγεται από ανθρώπους.

Αυτές οι συνέπειες, τόσο για τους δημιουργούς περιεχομένου, όσο και στο κομμάτι της δημοκρατίας και της παραπληροφόρησης, είναι ένα σοβαρό θέμα συζήτησης όχι για το μέλλον, αλλά για τώρα – και ίσως οι προεκτάσεις που μπορεί να πάρει το φαινομενικά αθώο και παιχνιδιάρικο «AI slop» να είναι μεγαλύτερες από αυτές που μπορούμε να φανταστούμε.

*Με πληροφορίες από Guardian, npr.org